飞源 API · 接入文档

国内直连 Claude 全家桶|OpenAI 兼容接口|微信支付宝充值

一、飞源 API 是什么

飞源 API 是 Anthropic Claude 的国内中转服务。客户不需要科学上网、不需要国外信用卡,直接用微信/支付宝充值就能调用最新的 Claude 模型。

核心优势:

| 优势 | 详情 |

|---|---|

| 🆕 首发最新模型 | Claude Opus 4.7(5/13 当天发布的旗舰)、Sonnet 4.6、Haiku 4.5 全家桶 |

| 🛡️ 走官方 API | 不是反代账号,永不封号,稳定性顶级 |

| 🔌 OpenAI 兼容 | 你现有的 Cherry Studio、ChatBox、Cursor、Dify 等客户端直接用,不改代码 |

| 💸 Prompt Caching | 重复 system prompt 自动 省 90% 输入费(Anthropic 原生支持) |

| 🇨🇳 国内直连 | Cloudflare 全球加速 + 香港回源,不用翻墙 |

| 💳 微信/支付宝 | 不需要国外信用卡,人民币直接充值 |

二、快速开始(3 分钟)

Step 1:获取 API Key

加客服微信 baote911 完成充值后获得:

- API Key:sk-xxxxxxxxxxxxxxxxxxxxxxxx

- Base URL:https://feiyuanapi.com

- 登录后台:https://feiyuanapi.com(看用量 + 自助管理 token)

Step 2:第一次调用

用 curl 验证(任何模型都行):

curl https://feiyuanapi.com/v1/chat/completions \

-H "Authorization: Bearer sk-你的key" \

-H "Content-Type: application/json" \

-d '{

"model": "claude-opus-4-7",

"messages": [{"role":"user","content":"你好,介绍下你自己"}]

}'

返回 Claude 的回复就成功了。

Step 3:接入你的应用

任何 OpenAI 兼容客户端,把 Base URL 改成 https://feiyuanapi.com 即可(详见第四章)。

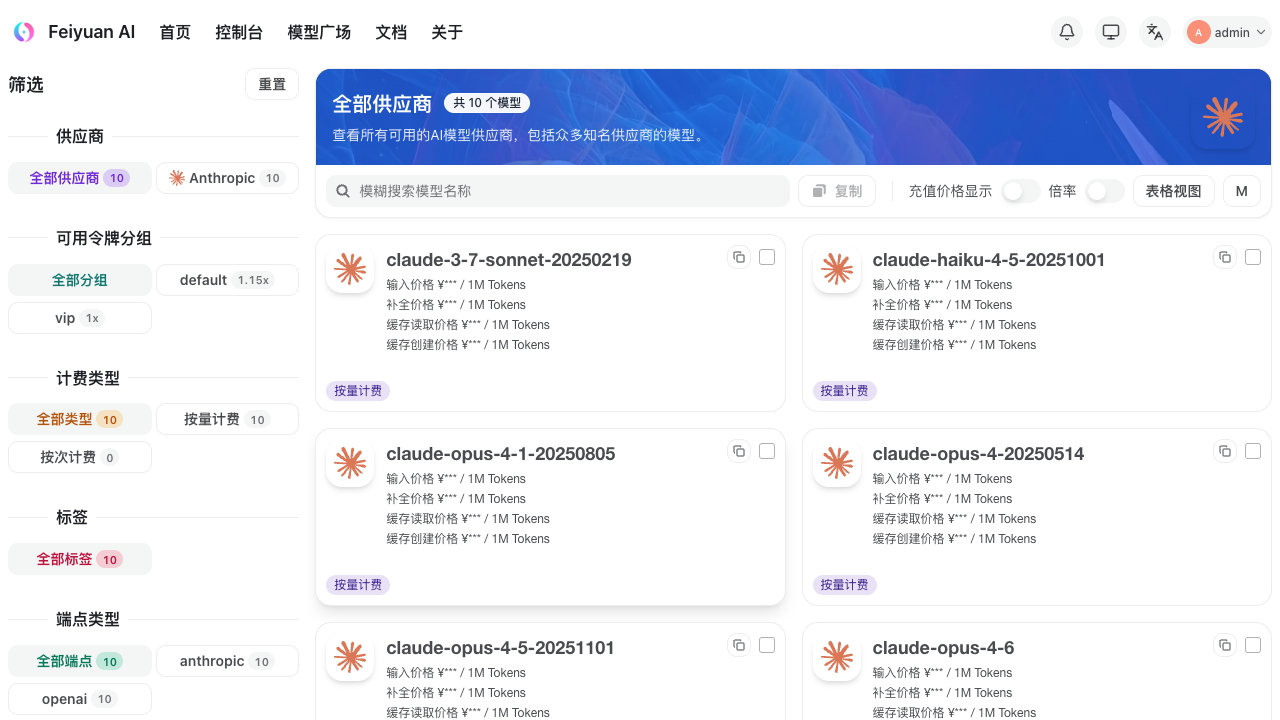

三、模型清单 & 价格

可用模型(7 个,全部 2025-2026 最新版)

| 模型 ID | 适合场景 | input/output 元/百万字 |

|---|---|---|

claude-opus-4-7 ⭐ 旗舰 |

最强代码 + 推理 + Agent | 41 / 207 |

claude-opus-4-6 |

强(4.6 代旗舰) | 41 / 207 |

claude-opus-4-5-20251101 |

4.5 代 Opus | 41 / 207 |

claude-sonnet-4-6 ⭐ 性价比 |

速度+智能平衡 | 25 / 124 |

claude-sonnet-4-5-20250929 |

经典 4.5 Sonnet | 25 / 124 |

claude-haiku-4-5-20251001 ⭐ 最快 |

高并发、低成本 | 8.3 / 41 |

已下线老模型:

claude-3-7-sonnet、claude-sonnet-4-20250514、claude-opus-4-20250514(后两者 Anthropic 将于 6/15 退役)。价格按 Anthropic 官方价 × 1.15 倍 × 汇率 7.2 计算。VIP 客户 1.0×(月消费 ≥ $50 升级),SVIP 0.9×(年付/合作伙伴)。

价格直观感受

| 典型场景 | 估算成本 |

|---|---|

| 1 次代码生成(Cursor,Opus 4.7) | 0.5 - 2 元 |

| 1 篇文章润色(Sonnet 4.5,5K tokens) | 0.3 元 |

| 100 次日常聊天(Haiku 4.5) | 约 5 元 |

| 1 万字技术文档翻译(Sonnet) | 约 3 元 |

Prompt Caching 省钱机制

使用 Anthropic 原生 Cache,重复 system prompt 部分按 10% 计费:

| 场景 | 不用 Cache | 用 Cache |

|---|---|---|

| Dify 工作流(固定 5000-token 系统提示×100 次调用) | ~250 元 | ~28 元(省 89%) |

| Cursor Agent(固定项目上下文 10000 token×50 次) | ~250 元 | ~30 元(省 88%) |

具体用法见第六章。

四、客户端接入示例

开发者优先看 4.1-4.3(Claude Code / Codex / Hermes 三大 CLI 工具);用聊天客户端的看 4.4 起。

4.1 Claude Code(Anthropic 官方 CLI)⭐⭐⭐ 开发者首选

Anthropic 官方的 AI 编程助手,最强代码生成。配合飞源 API key 直接用最新 Opus 4.7。

安装:

# macOS

brew install --cask claude

# 或者 Node.js(跨平台)

npm install -g @anthropic-ai/claude-code

配置(推荐写进 ~/.zshrc 或 ~/.bashrc):

export ANTHROPIC_BASE_URL="https://feiyuanapi.com"

export ANTHROPIC_API_KEY="sk-你的飞源key"

# 可选:指定默认模型

export ANTHROPIC_MODEL="claude-opus-4-7"

使用:

claude

# 进入交互模式,开始对话

💡 省钱技巧:Claude Code 内置 Prompt Caching,自动缓存项目上下文,第 2 次调用起省 90% 输入费。固定 system prompt 长度 > 4096 tokens 时触发。

4.2 Codex CLI(OpenAI 官方 CLI)

OpenAI 官方 CLI 工具,可改 endpoint 调飞源 Claude 模型。

安装:

npm install -g @openai/codex

配置:

环境变量法(推荐):

export OPENAI_API_BASE="https://feiyuanapi.com/v1"

export OPENAI_API_KEY="sk-你的飞源key"

或者修改 ~/.codex/config.toml:

# 指定走飞源的 Claude 模型

model = "claude-opus-4-7"

model_reasoning_effort = "medium"

使用:

codex "帮我写一个 Python 快排"

# 或进入交互模式

codex

⚠️ 注意:model 字段必须填飞源支持的 Claude 模型名(claude-opus-4-7、claude-sonnet-4-6、claude-haiku-4-5-20251001 等)。不要填 gpt-* 飞源不支持。

4.3 Hermes(开源 AI Agent 框架)

如果你在用 Hermes Agent 框架(本地 AI agent CLI),可以让 Hermes 走飞源 Claude 后端。

修改 ~/.hermes/config.yaml:

model:

default: claude-opus-4-7

provider: openai # 用 OpenAI 兼容协议

base_url: https://feiyuanapi.com/v1

api_key: sk-你的飞源key

使用:

hermes

# 或者

hermes "帮我处理这个项目里的所有 markdown 文件"

Hermes 子任务(vision/web_extract/compression 等)继承默认 provider 配置。如需为单个子任务用不同模型,可在对应子块单独配置。

4.4 Cursor(AI 代码编辑器)

Settings → Models → Custom OpenAI API:

- Base URL:https://feiyuanapi.com/v1

- API Key:你的 sk-xxx

- Model Name:claude-sonnet-4-6 或 claude-opus-4-7

- 关闭"Use Cursor's API"

4.5 Cherry Studio(桌面版 AI 客户端)

设置 → API 服务商 → 新建:

- 名称:飞源

- API URL:https://feiyuanapi.com

- API Key:你的 sk-xxx

- 模型:手动添加 claude-opus-4-7、claude-sonnet-4-6 等

4.6 ChatBox

设置 → AI 模型提供方 → 选择 「OpenAI API」 → 自定义 API Host:

- API Host:https://feiyuanapi.com

- API Key:你的 sk-xxx

- 模型:claude-opus-4-7(自定义模型名)

4.7 Dify(开源 LLMOps 平台)

模型供应商 → OpenAI 兼容 → 添加:

- 模型名称:claude-opus-4-7

- API endpoint URL:https://feiyuanapi.com/v1

- API Key:你的 sk-xxx

- 最大 token:8000(Opus)/ 4096(Sonnet)

4.8 LobeChat

设置 → 语言模型 → OpenAI:

- API 代理地址:https://feiyuanapi.com/v1

- API Key:你的 sk-xxx

- 模型列表:自定义添加 Claude 系列

4.9 Open WebUI

管理员设置 → OpenAI API:

- API Base URL:https://feiyuanapi.com/v1

- API Key:你的 sk-xxx

五、SDK 调用示例

5.1 Python(OpenAI SDK,最简单)

pip install openai

from openai import OpenAI

client = OpenAI(

api_key="sk-你的key",

base_url="https://feiyuanapi.com/v1"

)

response = client.chat.completions.create(

model="claude-opus-4-7",

messages=[

{"role": "system", "content": "你是一个专业的代码助手"},

{"role": "user", "content": "用 Python 写一个快排"}

],

max_tokens=1000

)

print(response.choices[0].message.content)

print(f"用了 {response.usage.total_tokens} tokens")

5.2 Python(Anthropic 原生 SDK,支持 Cache)

pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="sk-你的key",

base_url="https://feiyuanapi.com" # 注意:Anthropic SDK 不要加 /v1

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1000,

messages=[

{"role": "user", "content": "你好"}

]

)

print(response.content[0].text)

5.3 JavaScript / Node.js

npm install openai

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: 'sk-你的key',

baseURL: 'https://feiyuanapi.com/v1',

});

const response = await client.chat.completions.create({

model: 'claude-sonnet-4-6',

messages: [{ role: 'user', content: '你好' }],

});

console.log(response.choices[0].message.content);

5.4 流式输出(边出边显示)

stream = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "写一首关于秋天的诗"}],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

六、Prompt Caching 省钱实战

什么是 Prompt Caching

Anthropic 提供的官方功能:重复的 system prompt / 上下文,第 2 次起按 10% 价格计费。

适用场景:

- Dify / Coze 工作流(固定系统提示)

- 多轮对话(角色卡 / 知识库不变)

- 代码助手(项目上下文不变)

注意:必须用 Anthropic 原生格式

最小缓存长度:

- Sonnet 4.5/4.6:1024 tokens

- Opus 4.7/4.6:4096 tokens

- Haiku 4.5:4096 tokens

短于这个长度不会被缓存(Anthropic 静默忽略 cache_control 标记)。

代码示例

from anthropic import Anthropic

client = Anthropic(

api_key="sk-你的key",

base_url="https://feiyuanapi.com"

)

# 长系统提示(如知识库、文档)

long_context = "你是一个专业的法律顾问,熟知中华人民共和国全部法律法规..." * 100 # 假设 >1024 tokens

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1000,

system=[

{

"type": "text",

"text": long_context,

"cache_control": {"type": "ephemeral"} # 关键:标记此部分缓存

}

],

messages=[

{"role": "user", "content": "公司股权稀释合同要注意什么?"}

]

)

# 看 usage 验证缓存效果

print(f"input: {response.usage.input_tokens}")

print(f"cache 写入: {response.usage.cache_creation_input_tokens}")

print(f"cache 命中: {response.usage.cache_read_input_tokens}")

print(f"output: {response.usage.output_tokens}")

Cache 效果

| 调用次数 | input_tokens | cache_creation | cache_read | 计费 |

|---|---|---|---|---|

| 第 1 次 | 8(用户提问) | 2602(写入) | 0 | 全价(写入 +25%) |

| 第 2 次 | 8 | 0 | 2602(命中) | 10%(省 90%) |

| 第 N 次(5 分钟内) | 8 | 0 | 2602 | 10% |

5 分钟后缓存自动过期,下次再调用就要重新写入。

七、限制和错误处理

7.1 频率限制

| 限制 | 数值 |

|---|---|

| 单 API Key 调用频率 | 200 次/分钟 |

| 单次请求超时 | 600 秒(10 分钟,适配大 token 输出) |

| 单次最大 max_tokens | 64K(Sonnet)/ 128K(Opus) |

超限会返回 HTTP 429,等几秒重试即可。

7.2 常见错误码

| HTTP 码 | 原因 | 解决 |

|---|---|---|

| 401 | API Key 无效 | 检查 Key 是否正确,是否被禁用 |

| 402 | 余额不足 | 后台充值 |

| 403 | 调用模型未授权 | 该 token 不在允许的分组 |

| 429 | 频率超限 | 等 1 分钟重试,或升级 VIP |

| 500 | 上游错误 | 重试,多次失败联系客服 |

| 503 | 渠道繁忙 | 稍后重试 |

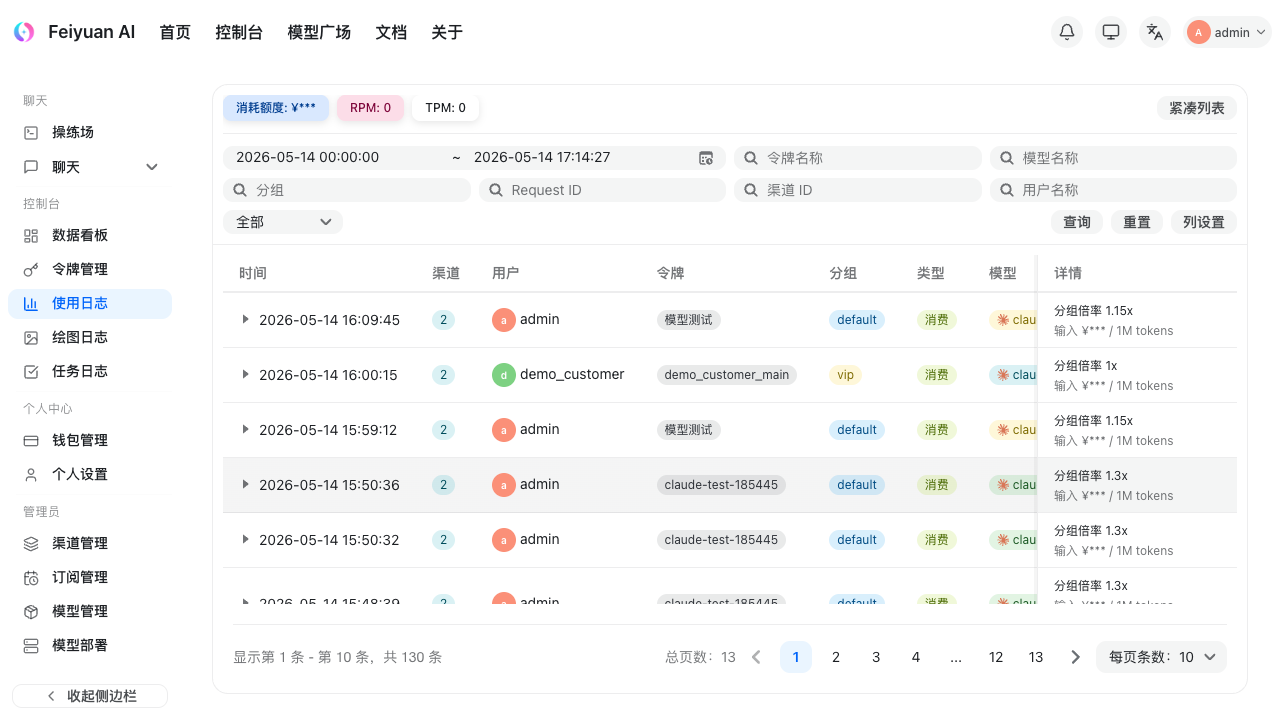

7.3 自助查用量

登录 https://feiyuanapi.com → 「日志」 查每次调用详情 + 计费 → 「令牌」 查余额

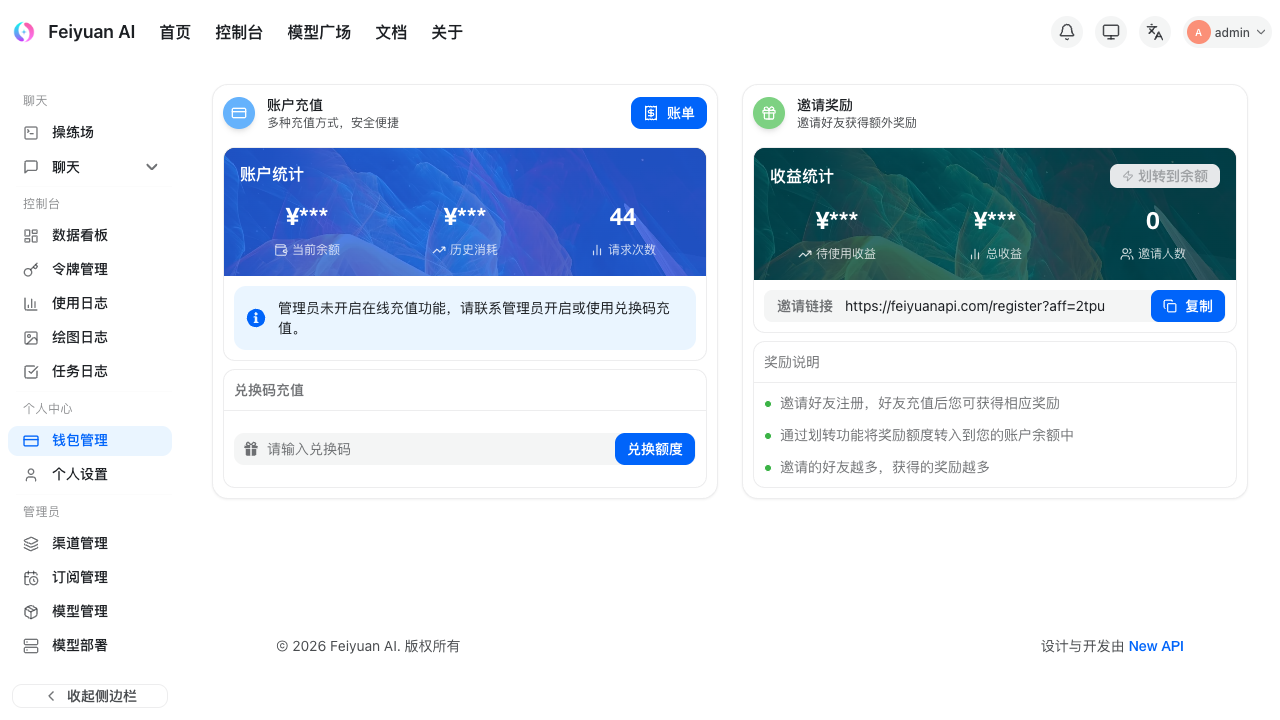

八、计费说明

计费规则

单次调用费用 =(input_tokens × input 单价 + output_tokens × output 单价 × completion_ratio)× 分组倍率

余额到期 / 不足处理

- 余额 < 50000 quota(约 0.7 元)时邮件提醒

- 余额 = 0 时调用返回 402 错误

- 续费后即时生效

自助充值

试运营阶段暂不支持自助充值,请加客服微信 baote911 充值。

充值倍率:1 元 = quota 数(按当时汇率计算,看后台「兑换记录」)。

九、邀请有礼

| 奖励对象 | 奖励 |

|---|---|

| 邀请人(你) | 朋友充值后立得 35 元 quota ≈ 7 次 Opus 调用 |

| 被邀请人(朋友) | 注册自动送 7 元 quota,立即可用 |

| 大额返佣 | 朋友单笔 ≥200 元,邀请人可申请补足到 10% 返现 |

申请方式:朋友注册时输入你的邀请码(后台「邀请」页面可获取)

十、常见问题(FAQ)

Q1:飞源 API 跟同行有什么不一样?

A:99% 同行卖 Claude 3.7/4,飞源直供 5/13 当天发布的 Opus 4.7。同时走官方 API(不是反代号),永不封号。

Q2:客户端怎么知道用哪个模型?

A:常用场景推荐:

- 写代码 / 复杂推理 → Opus 4.7

- 日常聊天 / 文章润色 → Sonnet 4.6 或 4.5

- 大批量翻译 / 简单问答 → Haiku 4.5

Q3:可以做 Function Calling / Tool Use 吗?

A:可以。完全兼容 Anthropic 原生 tools 参数(用 Anthropic SDK 时)和 OpenAI tools 参数(用 OpenAI SDK 时)。

Q4:支持 Vision(图像理解)吗?

A:支持。Claude 全系列支持图像输入,按 token 计费(图像约消耗 1500 tokens)。

Q5:Batch API 支持吗?

A:暂不支持(试运营阶段)。需要批量异步处理的客户请等待 Phase 2 上线。

Q6:充值后多久到账?

A:人工充值,1-10 分钟内到账。后台「日志」可看充值记录。

Q7:API Key 泄露怎么办?

A:后台「令牌管理」→ 删除旧 token → 新建 token。

Q8:可以退款吗?

A:未使用部分 7 天内可全额退款,已使用部分按实际计费扣除。

Q9:能开发票吗?

A:试运营阶段不开票,正式运营后支持。

Q10:跟 ChatGPT 镜像站有什么区别?

A:飞源是API 服务(给开发者 / Dify / Cursor 等程序调用),不是 ChatGPT 镜像(在网页直接聊天)。如果你想直接用网页聊天,不需要飞源。

十一、联系方式

| 联系方式 | 详情 |

|---|---|

| 客服微信 | baote911 |

| Telegram | @baote911 |

| 控制台 | https://feiyuanapi.com |

| 工作时间 | 24h 自助 / 微信回复一般 1 小时内 |

文档版本:v1.0|更新于 2026-05-14|飞源 API 团队